Le Socle Invisible de votre Performance SEO

96% des sites présentent des erreurs critiques bloquant leur indexation. Crawl Budget, Rendu JavaScript, Architecture : je ne liste pas des bugs, je répare le moteur de votre croissance.

Votre site envoie-t-il ces signaux de détresse ?

La technique n’est pas une option. Si le socle est instable, tout investissement en contenu ou en netlinking est une perte financière directe.

Indexation Bloquée

Vos nouvelles pages mettent des semaines à apparaître ou restent en statut « Découverte – actuellement non indexée » dans la Search Console.

Trafic en Chute Libre

Suite à une refonte ou une migration, vous avez perdu 30% de trafic. C’est souvent le signe de redirections cassées ou d’erreurs 404 massives.

Guerre des URL (Cannibalisation)

Google hésite entre plusieurs versions de vos pages (HTTP vs HTTPS, paramètres d’URL, facettes). Résultat : aucune ne ranke.

L’Audit en 4 Piliers Fondamentaux

Crawl Budget & Gaspillage (L’Économie du Bot)

Google alloue un temps limité à votre site. Si Googlebot passe son temps à crawler des pages inutiles, il ne verra jamais vos pages stratégiques. Mon audit identifie précisément où vous perdez de l’argent.

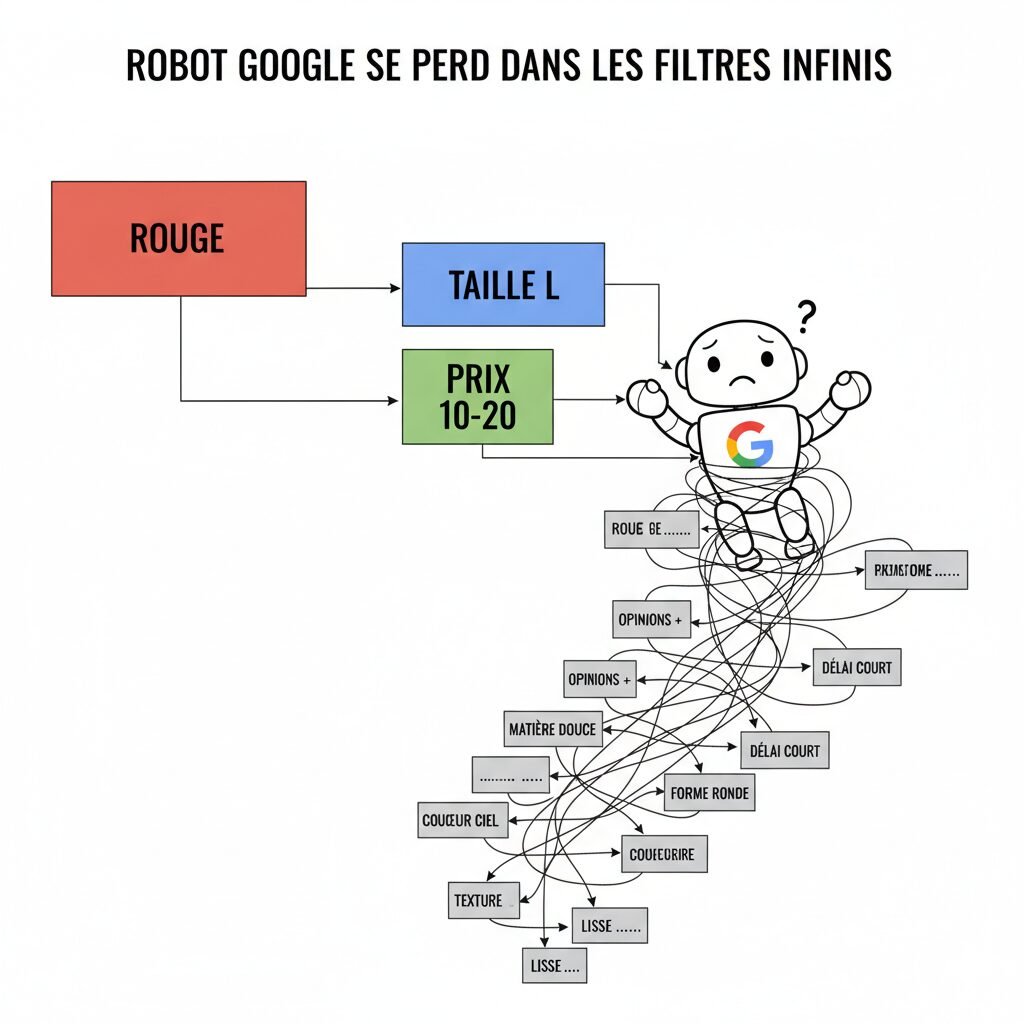

Le Fléau des Facettes & Spider Traps

Sur les sites E-commerce, les filtres (taille, couleur, prix) peuvent générer des millions d’URL uniques inutiles. Si elles sont accessibles au crawl, c’est un Spider Trap. Je vérifie la gestion de votre robots.txt et de vos balises noindex pour fermer ces pièges.

- Analyse des Logs : Comparaison entre les pages crawlées par Google et vos pages stratégiques.

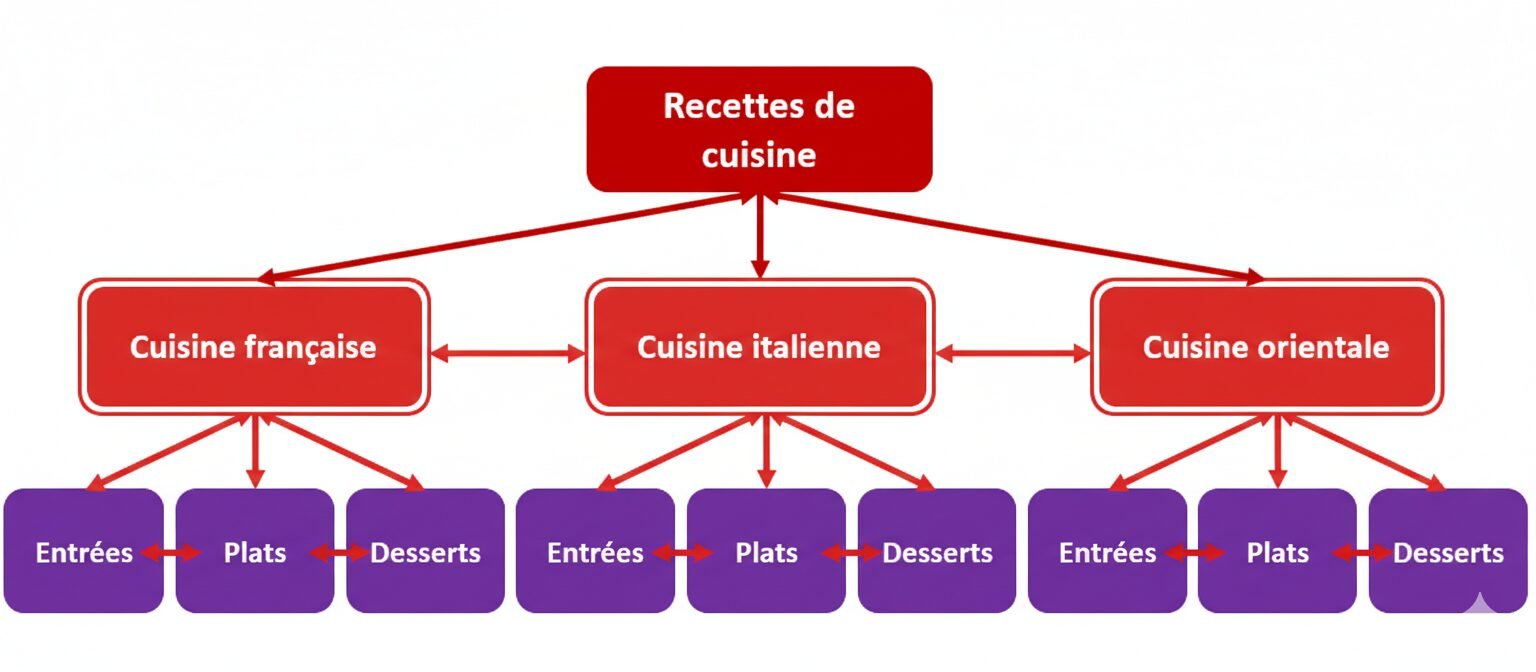

- Profondeur de Crawl : Vos pages importantes sont-elles à plus de 3 clics de l’accueil ?

- Budget Crawl mal réparti : Identification des pages « Panier », « Compte client » ou « Tri par prix » qui consomment du budget pour rien.

Indexabilité & Architecture Technique

Une fois le bot sur la page, sait-il quoi en faire ? L’architecture technique doit guider Google sans ambiguïté.

Canonicalisation

L’arme anti-duplicate content. Je vérifie que chaque page déclare sa version officielle (self-referencing ou vers la page mère) pour éviter la dilution de puissance.

Hreflang (International)

Critique pour le multilingue. Les erreurs de codes pays (ex: ‘en-UK’ au lieu de ‘en-GB’) ou l’absence de liens de retour (return tags) tuent votre SEO international.

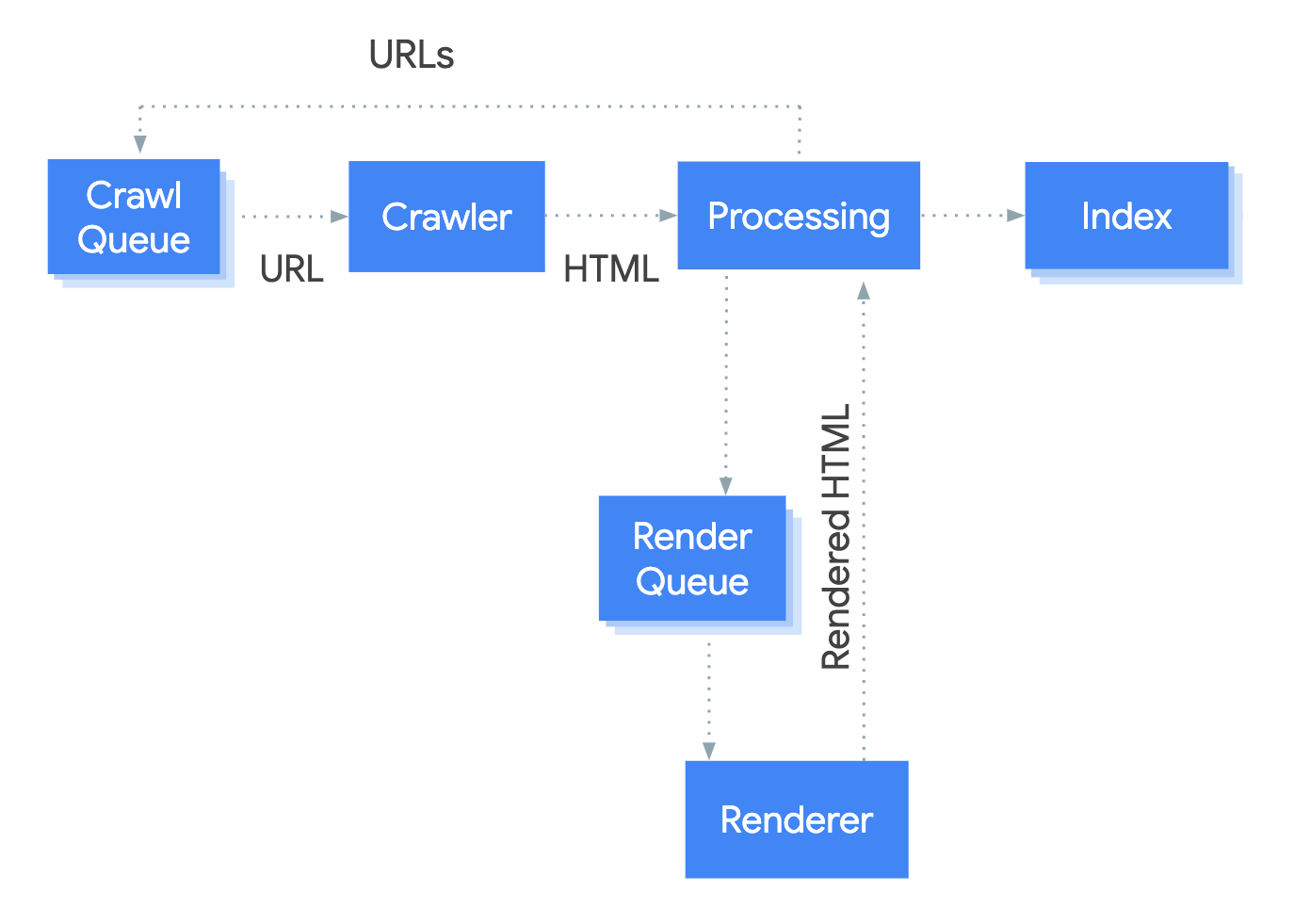

JavaScript SEO & Rendu (Le Challenge Moderne)

Aujourd’hui, Googlebot exécute le JavaScript, mais cela lui coûte cher. Si votre contenu dépend entièrement du JS (Client-Side Rendering), vous risquez des délais d’indexation ou une invisibilité totale.

- Analyse DOM vs Code Source : Je vérifie si vos liens et contenus critiques sont présents dans le code source initial ou s’ils nécessitent une exécution JS.

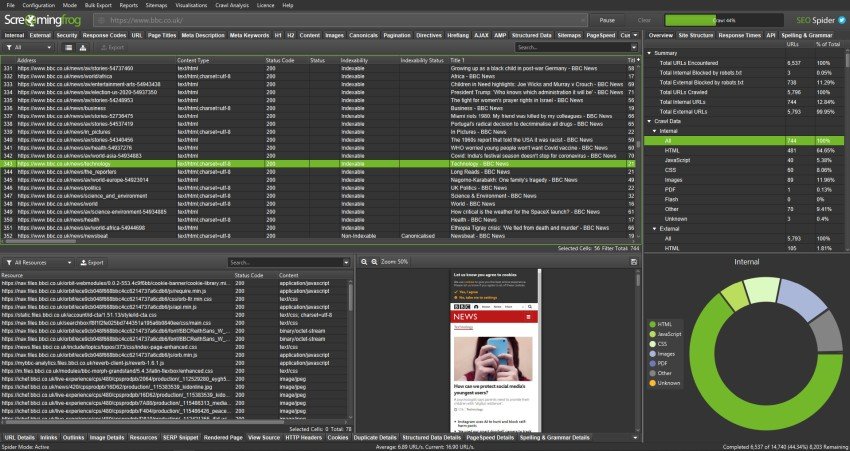

- Lecture des Crawlers : Test de rendu avec Screaming Frog (moteur Chromium) pour voir exactement ce que voit Google.

- Solutions de Rendu : Recommandations sur le SSR (Server-Side Rendering) ou le Dynamic Rendering si nécessaire.

Données Structurées (Schema.org)

Aider Google à comprendre les entités de votre site n’est plus du bonus, c’est un standard. J’audite et valide l’implémentation de vos schémas pour dominer les résultats enrichis.

Mes Outils & La Méthode de Priorisation

Je n’utilise pas des outils automatisés gratuits qui vous donnent des faux positifs. J’utilise la référence du marché, Screaming Frog, avec une configuration « Maison » (User-Agent Googlebot Smartphone, Rendu JS activé, extraction XPath personnalisée).

Mais surtout : Je ne vous rends pas un fichier Excel de 5000 lignes illisible. Je classe les correctifs par une matrice Effort / Impact Business.

- P1 Critique (Urgent) : Bloque l’indexation ou le crawl (ex: Robots.txt, Noindex, Boucles de redirection).

- P2 Important : Impacte le ranking (ex: Hn, Title, Maillage, Performance).

- P3 Optimisation : Bonus sémantique (ex: Schema.org, Optimisation images avancée).

Étude de Cas : Sauvetage E-Commerce

Le Client

E-commerce Mode (50 000 produits)

Stagnation du CA et seulement 30% du catalogue indexé.

- ✖ Spider Trap dans le filtre « Prix » (génération d’URL infinies).

- ✖ Contenu produit chargé en JS (React) invisible au premier passage.

- ✖ Budget crawl dilué sur des pages « Mot de passe oublié ».

Plan d’Action Technique

Fermeture des vannes (Robots.txt)

Blocage immédiat des paramètres de filtres combinés et des pages utilisateurs dans le robots.txt.

Optimisation du Rendu (Prerendering)

Mise en place d’une solution de Prerendering pour servir du HTML statique à Googlebot.

Nettoyage de l’Index

Demande de suppression des URL parasites via GSC et mise en place de Canonicals strictes.

Résultats (M+4)

| KPI | Avant | Après | Évolution |

|---|---|---|---|

| Pages Indexées | 15,000 | 48,500 | +223% |

| Crawl Budget Utile | 20% | 85% | Optimisé |

| Trafic Organique | Stagnant | Croissance | +60% |

Questions Fréquentes sur l’Audit Technique

Mon développeur peut-il faire l’audit lui-même ?

C’est une erreur courante. Un développeur code pour la fonctionnalité et l’expérience utilisateur. Un consultant SEO code pour l’indexabilité et la compréhension des robots. Ce sont deux métiers différents. Je travaille souvent avec vos développeurs pour leur donner des spécifications précises qu’ils peuvent implémenter.

C’est quoi exactement le « Crawl Budget » ?

Le Crawl Budget est le nombre de pages que Googlebot va visiter sur votre site avant de repartir. Ce budget dépend de l’autorité de votre site (popularité) et de la vitesse de votre serveur. Si vous avez 10 000 pages mais un budget de 500 pages/jour, il faudra 20 jours à Google pour tout voir… si l’architecture est parfaite. Sinon, il tournera en rond.

Pourquoi le JavaScript est-il dangereux pour le SEO ?

Les frameworks modernes (React, Vue, Angular) chargent souvent le contenu côté client (dans le navigateur). Googlebot doit donc « rendre » la page comme un navigateur pour voir le texte et les liens. Cela demande beaucoup de ressources CPU. Google peut donc décider de différer ce rendu, retardant l’indexation de vos pages de plusieurs jours, voire semaines.

Qu’est-ce qu’une erreur Soft 404 ?

Une page « Soft 404 » est une page qui dit à l’utilisateur « Produit non trouvé » mais qui renvoie un code technique « 200 OK » à Google. Pour Google, la page existe et est vide. C’est catastrophique pour la qualité globale du site (Panda). L’audit permet de détecter ces faux positifs.

Votre site a-t-il des freins invisibles ?

Ne laissez pas des erreurs techniques ruiner vos efforts de contenu. Obtenez une feuille de route claire et priorisée.

Demander un Pré-Audit completAnalyse manuelle + Crawl Screaming Frog. Réponse sous 24h.